Les expressions se multiplient, quand on parle d’intelligence artificielle. Mais qu’est-ce qu’un neurone artificiel ? Et quelle différence entre une hallucination humaine et celle d’une machine ?

Machine learning, apprentissage non-supervisé, hallucinations... Au gré de nos articles sur l’intelligence artificielle, nous utilisons à loisir tout un vocabulaire qui, s’il est souvent tiré d’activités humaines, qualifie bien des éléments spécifiques au champ informatique.

Après avoir décortiqué une partie des expressions génériques qui qualifient certains champs et sous-champs du domaine, intéressons-nous donc au fonctionnement plus précis des systèmes d’IA.

Nos autres lexiques de l’IA :

- AGI, GPAI, modèles de fondation… de quoi on parle ?

- IA : Prompt injection, empoisonnement… de quoi on parle ?

Machine learning, deep learning

Entraînés sur de vastes sommes de données, les modèles d’apprentissage machine (machine learning) y détectent des schémas et des tendances qui leur permettent de réaliser des prédictions ou des recommandations de plus en plus précises, au fil des essais/erreurs et/ou des optimisations réalisées par leurs constructeurs.

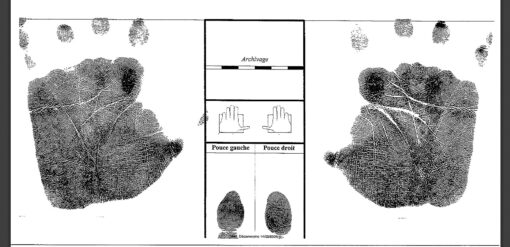

Sous-champ de ce domaine, le deep learning, ou apprentissage profond, concerne des systèmes algorithmiques construits sur une architecture en réseau de neurones artificiels à multiples couches – plus il y a de couches de neurones artificiels, plus le modèle est profond.

Si l’apprentissage machine est le domaine qui fait le plus parler depuis bientôt une quinzaine d’années, il est loin d’être le seul axe par lequel créer des modèles d’intelligence artificielle. Les systèmes experts, qui fonctionnent avec des règles préétablies, sont une autre manière d’en construire. Ils fonctionnent notamment à l'aide de moteurs d’inférence.

Commentaires (7)

#1

(Pas taper mais je n'en ai fait qu'une lecture rapide pour le moment mais je le reprendrait plus intensément plus tard)

Ca me fait penser à une vidéo de Officiel DEFAKATOR [https://youtu.be/iAy-cw4uSpE?si=fkP7UrV1hrs7y2uu], sur l' "IA".

Digression : A force de lire et relire des sujets sur le sujet, j'ai le sentiment qu'il y a un consensus pour dire que IA est impropre et confusant.

Qu'est-ce qui correspondrait le mieux ?

AA Apprentissage artificiel ? (Et non Alcoolique Anonyme)

ASA Analyse et Synthétise Algorithmique ? (Et non Absence Spéciale Autorisée)

#1.1

[Édito] Crypter, chiffrer : le défi de la vulgarisation

Historique des modifications :

Posté le 05/04/2024 à 11h25

Je pense que c’est un peu la même problématique avec chiffrer et crypter, entre l’usage et la compréhension d’un côté et l’aspect plus technique de l’autre.

https://next.ink/120490/edito-crypter-chiffrer-le-defi-de-la-vulgarisation/

#2

#3

C'est au contraire sa principale fonctionnalité : imaginer, inventer, produire (ne prenez pas ces mots au pied de la lettre en me disant que c'est que du compute, c'est pas le sujet). Si la demande est d'avoir un système répondant avec exactitude et précision, déterministe, et ne faisant pas d'erreur, c'est pas l'IA générative qu'il faut utiliser mais une base de données et un index, et un machine learning plus classique comme celui utilisé pour identifier des tendances dans des logs applicatives par exemple. Dans un tel cas d'usage, l'intérêt de l'IA générative serait plutôt de synthétiser et extraire de l'information à partir de données cohérentes et définies. Ce qui revient à faire du RAG.

A l'inverse, si on demande à l'IA générative de produire des itérations de possibilités, ce qui au final est son job (générative n'est pas là pour rien, sinon encore une fois c'est juste un index et une BDD qu'il vous faut), c'est là qu'on peut exploiter son potentiel.

L'un des autres points avec lesquels j'ai toujours du mal, c'est de reprocher à l'intelligence artificielle les erreurs qu'elle peut générer, alors que c'est un produit créé par des humains. Machins biologiques imparfaits et qui passent leur temps à en faire des erreurs. Comment peut-on espérer la perfection quand le créateur ne l'est pas ?

Cela me fait donc souvent questionner sur l'attente autour de l'IA. Si l'idée est d'avoir une chose infaillible, désolé, mais ça n'arrivera jamais. Si l'IT était infaillible, je serais chômeur depuis très longtemps.

Pour moi, le principal problème se trouve autour de nos attentes et rapport vis à vis de notre technologie. Si on attend d'elle qu'elle soit constamment parfaite et infaillible sans jamais la remettre en question, dans ce cas on va droit dans le mur. Dans le même mur que se prennent les personnes subissant la désinformation de masse car consommant passivement et stupidement les contenus déversés par d'autres technologies via les entonnoirs à gavage. La confiance dans la technologie est une chose, mais comme dit l'adage : la confiance n'exclue pas le contrôle.

#4

Je ne comprends pas trop ce propos, les IA sont bien +/- la reproduction du fonctionnement du cerveau (des neurones et synapses). C'est certes dérangeant à concevoir, mais notre cerveau est également +/- une machine statistique.

La différence majeure est qu'un GPT est spécialisé dans la production de texte quand notre cerveau peut être vu comme un enchevêtrement de réseaux neuronaux interconnectés.

Une partie de notre cerveau fait du GPT, mais une autre partie raisonne / rationalise pour filtrer les incohérences.

GPT-like c'est un cerveau humain qui rêve, c'est au réveil que notre raison réalise les incohérences, entre les idées juste "j'étais dans un train", des incohérences / hallucinations "le tunnel débouchait dans mon salon, je regardais la TV et le train avait disparu".

La pensée et la raison c'est aussi fait avec des neurones et synapses, on n'a pas vraiment réussi à apprendre à un réseau de neurones artificiels à raisonner, mais ça arrivera vraisemblablement un jour ou l'autre.

#4.1

C'est même complètement ça. Même si dans notre modèle de pensée il y a encore des mécaniques incomprises, d'ordre général un raisonnement est une analyse de possibilités avec des pours et des contres en se basant sur nos connaissances, notre expérience, et des sources externes.

Ce que fait GPT aussi qui analyse toutes les possibilités pour prédire le prochain token d'une suite de texte.

D'ailleurs en parlant des mécaniques de notre cerveau, une intéressante est démontrée par l'idée du canard en plastique pour debugger.

Quand on raisonne intérieurement, le débit de pensée est rapide et part dans tous les sens. Lorsque le point de blocage arrive (le problème) et qu'on arrive pas à trouver la solution par soit-même, on s'adresse à une aide (ici : le canard). Plus on expose la problématique au canard, plus l'effet eureka ! arrive.

Pourquoi ? Tout simplement parce que lors de l'expression orale, le débit de pensée ralenti et devient plus concis. De plus, on ajoute des détails qu'on ignorerait implicitement car évidents.

D'un certain point de vue, un modèle d'IA générative a une variation similaire. Paramétré avec une température trop élevée (et pas que), il va évaluer beaucoup trop de possibilités et produire un contenu plus aléatoire. En somme, le modèle est créatif. Réduire sa température (ainsi que moduler d'autres params) revient à le rendre plus concis et précis, plus déterministe. Soit comme lorsqu'on s'exprime oralement au sujet d'une problématique et que l'effet eureka ! arrive.

Le fait d'avoir expérimenté avec le Mixtral 8x7B d'Infomaniak était même intéressant pour constater ces variations.

#5

« Au panthéon des films cultes : Terminator. Le premier opus sorti en 1984 fête ses 40 ans. Pourquoi sa réflexion sur l’intelligence artificielle fait-elle encore écho aujourd’hui en 2024?

Si l’œuvre de James Cameron est si culte, c’est parce qu’elle porte à l’écran un grand nombre de fantasme et de paranoïa : l’apocalypse nucléaire, la fin de l’humanité, le voyage dans le temps et l’éveil d’une IA qui se retournerait contre ses créateurs. En six films, la franchise interroge aussi la limite entre l’humain et la machine, avec, au fil de la saga, un T-800 qui s’humanise au point d’être capable de sourire, de ne plus avoir de mission, et qui finit par boire des bières. »

Historique des modifications :

Posté le 06/04/2024 à 18h40

Cet article me fait penser à un épisode de « La Science, CQFD » de France culture.fr :

« *Au panthéon des films cultes : Terminator. Le premier opus sorti en 1984 fête ses 40 ans. Pourquoi sa réflexion sur l’intelligence artificielle fait-elle encore écho aujourd’hui en 2024?

Si l’œuvre de James Cameron est si culte, c’est parce qu’elle porte à l’écran un grand nombre de fantasme et de paranoïa : l’apocalypse nucléaire, la fin de l’humanité, le voyage dans le temps et l’éveil d’une IA qui se retournerait contre ses créateurs. En six films, la franchise interroge aussi la limite entre l’humain et la machine, avec, au fil de la saga, un T-800 qui s’humanise au point d’être capable de sourire, de ne plus avoir de mission, et qui finit par boire des bières.* »

Posté le 06/04/2024 à 18h41

Cet article lexical me fait penser à un épisode de « La Science, CQFD » intitulé « Terminator : 40 ans, toujours pucé » (04/04/2024 –France culture.fr) :

« *Au panthéon des films cultes : Terminator. Le premier opus sorti en 1984 fête ses 40 ans. Pourquoi sa réflexion sur l’intelligence artificielle fait-elle encore écho aujourd’hui en 2024?

Si l’œuvre de James Cameron est si culte, c’est parce qu’elle porte à l’écran un grand nombre de fantasme et de paranoïa : l’apocalypse nucléaire, la fin de l’humanité, le voyage dans le temps et l’éveil d’une IA qui se retournerait contre ses créateurs. En six films, la franchise interroge aussi la limite entre l’humain et la machine, avec, au fil de la saga, un T-800 qui s’humanise au point d’être capable de sourire, de ne plus avoir de mission, et qui finit par boire des bières.* »

Posté le 06/04/2024 à 18h46

Cet article lexical me fait penser à un épisode de « La Science, CQFD » intitulé « Terminator : 40 ans, toujours pucé » (04/04/2024 –France culture.fr) :

« *Au panthéon des films cultes : Terminator. Le premier opus sorti en 1984 fête ses 40 ans. Pourquoi sa réflexion sur l’intelligence artificielle fait-elle encore écho aujourd’hui en 2024?

Si l’œuvre de James Cameron est si culte, c’est parce qu’elle porte à l’écran un grand nombre de fantasme et de paranoïa : l’apocalypse nucléaire, la fin de l’humanité, le voyage dans le temps et l’éveil d’une IA qui se retournerait contre ses créateurs. En six films, la franchise interroge aussi la limite entre l’humain et la machine, avec, au fil de la saga, un T-800 qui s’humanise au point d’être capable de sourire, de ne plus avoir de mission, et qui finit par boire des bières.* »

Posté le 06/04/2024 à 18h47

Cet article lexical me fait penser à un épisode de « La Science, CQFD » intitulé « Terminator : 40 ans, toujours pucé » (04/04/2024 – France culture.fr) :

« *Au panthéon des films cultes : Terminator. Le premier opus sorti en 1984 fête ses 40 ans. Pourquoi sa réflexion sur l’intelligence artificielle fait-elle encore écho aujourd’hui en 2024?

Si l’œuvre de James Cameron est si culte, c’est parce qu’elle porte à l’écran un grand nombre de fantasme et de paranoïa : l’apocalypse nucléaire, la fin de l’humanité, le voyage dans le temps et l’éveil d’une IA qui se retournerait contre ses créateurs. En six films, la franchise interroge aussi la limite entre l’humain et la machine, avec, au fil de la saga, un T-800 qui s’humanise au point d’être capable de sourire, de ne plus avoir de mission, et qui finit par boire des bières.* »

Posté le 06/04/2024 à 18h48

Cet article lexical me fait penser à un épisode de « La Science, CQFD » intitulé « Terminator : 40 ans, toujours pucé » (04/04/2024 – franceculture.fr) :

« *Au panthéon des films cultes : Terminator. Le premier opus sorti en 1984 fête ses 40 ans. Pourquoi sa réflexion sur l’intelligence artificielle fait-elle encore écho aujourd’hui en 2024?

Si l’œuvre de James Cameron est si culte, c’est parce qu’elle porte à l’écran un grand nombre de fantasme et de paranoïa : l’apocalypse nucléaire, la fin de l’humanité, le voyage dans le temps et l’éveil d’une IA qui se retournerait contre ses créateurs. En six films, la franchise interroge aussi la limite entre l’humain et la machine, avec, au fil de la saga, un T-800 qui s’humanise au point d’être capable de sourire, de ne plus avoir de mission, et qui finit par boire des bières.* »